Chaîne de valeur biaisée, répercussions sur les cas d’usage, limites des impacts des actions marketing ou commerciales : les répercussions sur l’activité des entreprises d’une mauvaise qualité du patrimoine de données peuvent être lourdes. Rappelons-le, l’institut Gartner a récemment estimé à 11M€ annuels, le coût d’une mauvaise qualité des données pour les organisations.

La qualité des données doit donc être l’affaire de tous. Voici, point par point, la méthodologie et les actions à mettre en œuvre pour garantir la qualité de son patrimoine de données dans la durée, à l’échelle de toute l’organisation.

Qu’est-ce qu’une mauvaise qualité des données ?

La qualité de la data peut être mesurée à minima à deux niveaux :

- Au niveau des éléments qui définissent la donnée: les noms, les définitions d’objets, les définitions métier… En somme, tout ce qui demain sera exploité non seulement dans les outils de Master Data Management mais également dans les outils de gestion de la performance, de Business Intelligence ou de Data Visualisation.

- Au niveau de la donnée elle-même: les valeurs nulles, les anomalies, les erreurs de saisie que peut faire un opérateur dans un magasin, les doublons, les données obsolètes… Tout ceci représente 80% des problèmes que l’on rencontre actuellement dans les entreprises.

De nombreux critères sont à prendre en compte pour évaluer la qualité des données, surtout dans les organisations complexes où les données doivent être liées entre plusieurs systèmes, plusieurs filiales, plusieurs enseignes. Voici une vue d’ensemble de ces critères :

Le point primordial à retenir est la nécessité d’une démarche itérative. Une fois que les premiers critères de qualité sont traités, on arrive généralement très rapidement aux autres en poursuivant vers l’exhaustivité afin d’atteindre le « Graal » de la qualité intégrale des données.

Quelle place pour la qualité des données dans la stratégie de data management d’une entreprise ?

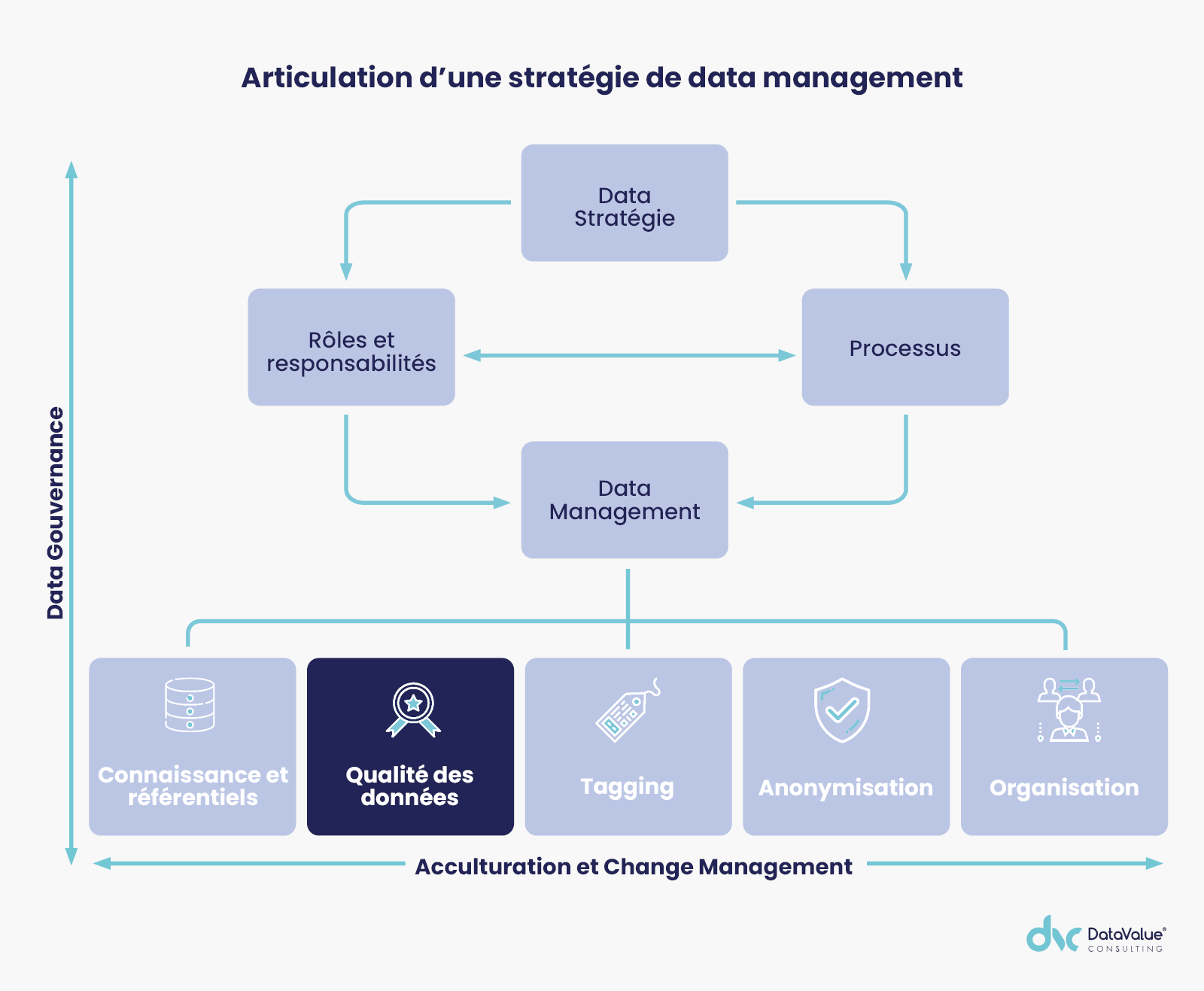

La qualité des données est aujourd’hui une composante fondamentale de la stratégie data management.

Pour rappel, la stratégie de data management concerne l’ensemble des processus, des rôles et des responsabilités que l’organisation va instaurer avec son Chief Data Officer pour gérer le cycle de vie des données. Les composants de cette stratégie data sont nombreux : traitement des référentiels, organisation dans l’entreprise, harmonisation, tagging, anonymisation, etc. La qualité de la data constitue le socle principal de tous ces éléments.

La mise en place de la stratégie de data management doit être accompagnée d’initiatives de conduite du changement et d’acculturation, structurées sur l’ensemble de l’organisation comme l’expose le schéma suivant :

Quels sont les leviers de traitement de la qualité de données ?

3 volets majeurs vont guider la démarche :

- Le curatif. C’est le dispositif qui va traiter les données en masse, essentiellement par des traitements automatisés qui vont traiter 80 à 85% de la donnée. Cette phase d’audit va permettre d’identifier les points d’achoppement : les problématiques de nom, d’adresses mail, de dates inexactes, de données obsolètes, etc… Tous ces traitements vont venir corriger en masse l’information.

- Le préventif. Il s’agit de l’ensemble des dispositifs qui vont s’installer dans le temps et qui vont assurer la cohérence globale, non seulement au niveau du silo qui a été traité mais également au niveau de la cohérence à l’échelle de l’entreprise. Le préventif prend forme à travers les corrections appliquées sur les processus et sur les anomalies identifiées dans la transformation de la donnée, de sa création à son archivage. Cela consiste à lier les données par les référentiels : vérifier si le contact client créé par un commercial est correct, si le SAV est parti avec les bonnes informations au niveau de la facturation, si le transfert des recouvrements sera correct en cas d’impayé, etc. Il faut mettre en place une bonne circulation de l’information au sein de l’entreprise.

- La transformation. Cette phase s’engage avec les problématiques de qualité qui seront remontées suite à l’exploitation des données, une fois que seront réalisés les premiers reporting ou que les premiers algorithmes seront développés, si jamais l’entreprise prévoit d’utiliser l’IA à court ou moyen terme.

Quelle est la méthodologie pour assurer une bonne qualité des données ?

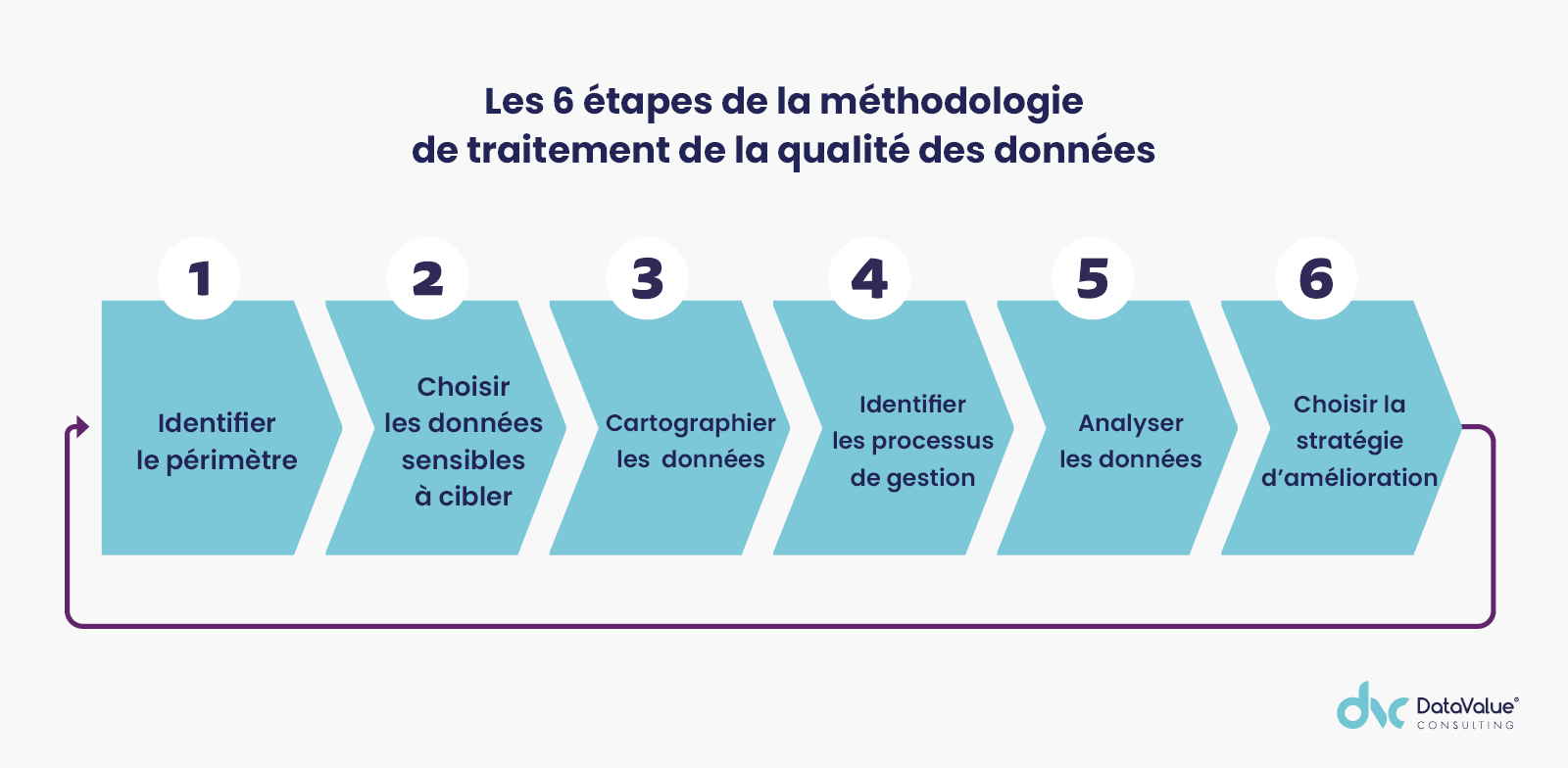

Cette méthodologie ou approche globale pour traiter la qualité des données se découpe en 6 étapes, avec différents inputs et livrables. Ceci pour sécuriser une démarche qui peut toucher des périmètres très larges.

La première phase consiste à identifier le périmètre sur lequel il va falloir non seulement détecter les problèmes mais également les corriger. Il peut s’agir en l’occurrence d’un silo de données, d’un département, d’une BU ou d’une filiale.

La seconde étape concerne la définition des données sensibles. Ce sont elles qui aujourd’hui vont donner un retour sur investissement, une fois les opérations de correction effectuées : contact client, contrats, produits, etc. En somme, tout ce qui est construit autour du référentiel central. C’est sur ce référentiel central que sont regroupées les données nécessaires aux opérations élémentaires dans une entreprise.

La troisième phase est celle qui va cartographier toutes ces données sensibles ainsi que les contenus (reporting, tableaux de bords…), applications ou outils qui leurs sont associés.

Ensuite vient la quatrième étape, la phase de gestion de processus. Elle va permettre d’identifier les cycles de vie de la donnée dans l’entreprise, de décrire formellement les règles qui régissent ou organisent la donnée, c’est à dire la donnée créée par un système. Pour prendre un exemple concret : un client amène son appareil en panne dans un service après-vente qui va retrouver la fiche client ou en créer une. Cette fiche va circuler pour arriver au service réparation. Après son intervention, le technicien va valider le dossier puis le transmettre au service facturation. Ce dernier, en cas de non-acquittement de la facture, va passer la main au recouvrement et au reste des services. C’est donc ce trajet de la donnée qui va non seulement permettre de visualiser l’information mais aussi, possiblement, la modifier. Certaines modifications à la marge induisent des erreurs. Tous ces processus doivent être étudiés au sein de l’entreprise, sur les périmètres préalablement ciblés, pour pouvoir aborder l’étape suivante.

La cinquième étape va consister à analyser les données, statiquement et dynamiquement. L’analyse statique se base sur des critères neutres et sans mouvements : un nom, une valeur par rapport à une autre, vérifier qu’une date de naissance est bien inférieure à la date du jour, etc.

Les analyses dynamiques entrent davantage dans le détail de toutes les modifications que subissent les données. Cette étape d’analyse va produire rapport d’audit qui donne l’état des lieux de la qualité des données d’un périmètre ; un rapport que l’on propose souvent à nos clients avant de pouvoir passer à la phase finale.

La sixième et dernière phase est donc celle du cadrage des stratégies d’amélioration à travers différents outils et méthodes. L’étape d’analyse permet de pointer un certain nombre de griefs : problèmes de complétude, de date, de cohérence, de noms, d’adresses e-mail, les moments de vie du client ou du prospect, les adresses e-mail associées, etc. Il est fréquent de comparer plusieurs bases pour traiter la cohérence de la donnée dans la globalité de l’entreprise. Un exemple serait de définir, pour un client disposant de plusieurs adresses, laquelle garder dans la suite du processus.

La stratégie d’amélioration est donc la dernière étape qui va venir, avec les outils et les méthodes recommandées, apporter un certain nombre de corrections et de préventions. La stratégie de correction et de traitement de la qualité de données va corriger l’existant (le volet curatif) et également assurer le préventif.

Ce traitement de la prévention va notamment consister à mettre en place un certain nombre d’indicateurs que sont les KPI de surveillance de la qualité de données. Le CDO et les Data Stewart seront en charge de monitorer les dashboards produits avec ces KPI (voir tableau ci-dessous). L’important est ensuite de maintenir l’effort de qualité sur la durée.

Quid des outils de qualité de données ?

Le recours aux outils est forcément inévitable mais un problème de qualité de données n’a jamais été réglé par un outil. Les gages de réussite sont le respect des processus et de la méthode, la capacité à générer des habitudes que l’organisation installe dans la durée.

Beaucoup d’entreprises ayant fait corriger l’intégralité de leurs données sont, 6 mois après, revenues quasiment à leur situation initiale parce car le travail curatif et correctif en profondeur sur les données n’avait pas été suivi par le préventif. Les acteurs ou pôles qui accompagnent les remontées mensuelles des écarts doivent les corriger à la même fréquence.

Le processus de mise en qualité des données peut être réalisé avec un ETL simple, avec des plateformes, avec du code ou d’autres moyens encore. La problématique de l’outil ne se pose qu’en dernière étape, en fonction de tout ce qui a été réalisé auparavant, du SI legacy de l’entreprise et de quelques requêtes spécifiques de sa part. L’on peut choisir le meilleur des outils, mais sans processus efficaces et durables, l’amélioration ne sera pas viable.

Par Abdelaziz Joudar

Président chez DataValue Consulting

![[Livre Blanc] Mise en oeuvre d'une stratégie de qualité des données](https://no-cache.hubspot.com/cta/default/8316412/5c497c77-e0eb-42ca-8820-192b669e0cbb.png)